Rynek QA w PL 2026: 4500+ ofert, 95% wymaga B2+ angielskiego. Manual junior 6-9k, automation junior 9-13k, SDET senior 19-30k.

Słownictwo: 80 terminów w 8 kategoriach (testing types, bug lifecycle, automation, agile, performance, security, AI/ML, career).

ISTQB Foundation: baseline certyfikat (60% ofert junior). Egzamin 200 EUR / 850 PLN, dostępny po polsku.

AI tools 2026: Copilot, ChatGPT (test cases), Applitools (visual), Mabl (self-healing automation).

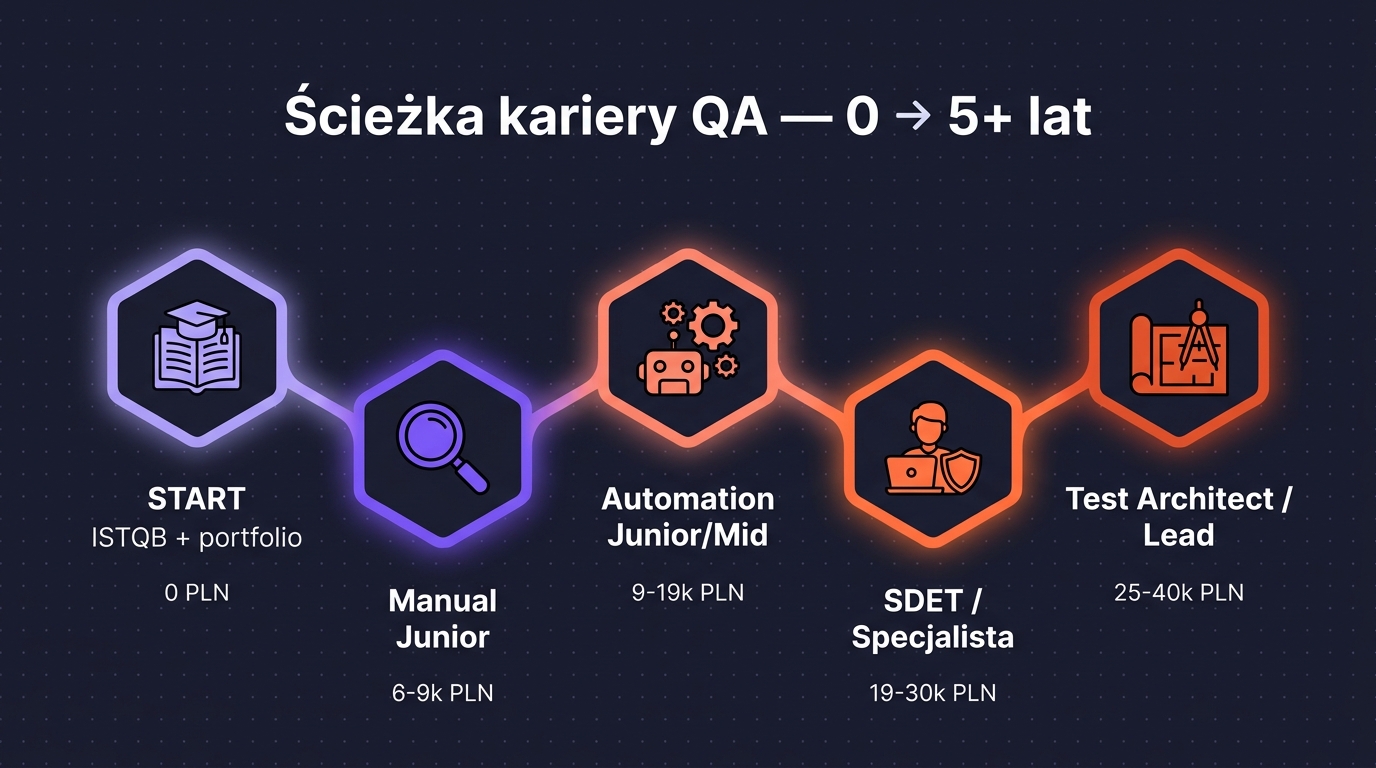

Ścieżka: Manual (rok 1-2) → Automation Junior (rok 2-3) → SDET / Specjalista (3-5 lat).

Słowniczek skrótów:

QA — Quality Assurance (zapewnienie jakości, proces).

QC — Quality Control (kontrola jakości, testowanie produktu).

SDLC — Software Development Life Cycle (cykl wytwarzania oprogramowania).

STLC — Software Testing Life Cycle (cykl testowania oprogramowania).

ISTQB — International Software Testing Qualifications Board (organizacja certyfikująca).

SDET — Software Development Engineer in Test (programista-tester).

CI/CD — Continuous Integration / Continuous Deployment.

UAT — User Acceptance Testing (testy akceptacyjne).

Rynek QA w PL 2026 — liczby

Trendy 2026:

- Automation rośnie szybko — firmy preferują testerów z umiejętnościami programowania (Java, Python, JavaScript).

- Manual nie ginie, ale staje się specjalizacją (exploratory testing, UX, accessibility).

- AI tools obowiązkowe — kandydat bez znajomości Copilot, ChatGPT dla QA = mniejsza konkurencyjność.

- Specjalizacje z najwyższym popytem: mobile testing (iOS/Android), performance testing (JMeter, k6), security testing, API testing (Postman, REST Assured).

- Domain expertise daje premium — banking, healthcare, e-commerce: +20-30% pensji.

80 terminów w 8 kategoriach

Kategoria 1: Testing types & levels (10)

Typy i poziomy testów

| EN | PL | Definicja |

|---|---|---|

| Unit testing | testowanie jednostkowe | Najniższy poziom — test pojedynczej funkcji / metody przez programistę. |

| Integration testing | testowanie integracyjne | Testowanie współpracy modułów (API, baza danych, serwisy zewnętrzne). |

| System testing | testowanie systemowe | Test całej aplikacji jako kompletnego systemu. |

| Acceptance testing (UAT) | testy akceptacyjne | Klient potwierdza, że system spełnia wymagania. |

| Smoke testing | testy dymne | Po nowym buildzie — sprawdzenie czy podstawowe funkcje działają. |

| Sanity testing | testy poprawności | Po fixie — sprawdzenie konkretnego obszaru, czy naprawione. |

| Regression testing | testy regresji | Po zmianie — sprawdzenie, czy nic innego się nie zepsuło. |

| Exploratory testing | testy eksploracyjne | Bez scenariusza, tester swobodnie eksploruje aplikację. |

| Functional testing | testy funkcjonalne | Co aplikacja robi (czy spełnia funkcjonalności). |

| Non-functional testing | testy niefunkcjonalne | Jak aplikacja działa (performance, security, usability, accessibility). |

Kategoria 2: Test design techniques (10)

Techniki projektowania testów

| EN | PL | Definicja |

|---|---|---|

| Black box testing | testowanie czarnoskrzynkowe | Bez znajomości kodu — tester widzi tylko interfejs. |

| White box testing | testowanie białoskrzynkowe | Z dostępem do kodu źródłowego. |

| Gray box testing | testowanie szaroskrzynkowe | Częściowy dostęp do kodu (np. baza danych, ale nie cały kod). |

| Equivalence partitioning | podział na klasy równoważności | Dane podzielone na grupy zachowujące się tak samo (testuj 1 reprezentanta). |

| Boundary value analysis (BVA) | analiza wartości brzegowych | Testuj wartości na granicy zakresu (min, min+1, max-1, max). |

| Decision table testing | testowanie tabel decyzyjnych | Macierz warunków → wyniki, dla testowania logiki biznesowej. |

| State transition testing | testowanie przejść stanów | Diagram stanów aplikacji — testowanie wszystkich przejść. |

| Pairwise testing | testowanie par | Pokrywa wszystkie pary kombinacji (zamiast pełnej kombinatoryki). |

| Risk-based testing | testowanie oparte na ryzyku | Priorytetyzacja testów według ryzyka biznesowego. |

| Use case testing | testowanie scenariuszy użycia | Testy na podstawie use cases / user stories. |

Kategoria 3: Bug lifecycle (10)

Cykl życia buga

| EN | PL | Definicja |

|---|---|---|

| Bug / Defect | bug / defekt | Błąd w działającym kodzie znaleziony podczas testów. |

| Error | błąd ludzki | Pomyłka programisty (przed kodem). |

| Failure | awaria | Defekt zauważony przez użytkownika końcowego. |

| Bug report / Defect report | zgłoszenie błędu | Formalny dokument opisujący buga (Jira ticket). |

| Severity | waga | Wpływ na system (Critical / High / Medium / Low). |

| Priority | priorytet | Jak pilne (P0 / P1 / P2 / P3). |

| Steps to reproduce | kroki do odtworzenia | Numerowana lista do replikacji błędu. |

| Reproducible / non-reproducible | odtwarzalny / nieodtwarzalny | Czy bug daje się powtórzyć (najgorsze: 'flaky' bugs). |

| Triage | triaż | Przegląd nowych bugów przez team — co fixujemy, co odkładamy. |

| Bug status flow | przepływ statusu buga | New → Assigned → In Progress → Fixed → Verified → Closed (lub Reopened). |

Kategoria 4: Automation testing (10)

Automation testing

| EN | PL | Definicja |

|---|---|---|

| Test script | skrypt testowy | Kod automatyzujący test (Selenium, Playwright, Cypress). |

| Test framework | framework testowy | Struktura kodu testowego (TestNG, JUnit, pytest, Mocha). |

| Page Object Model (POM) | model obiektowy strony | Wzorzec — każda strona to osobna klasa z metodami. |

| Locator / Selector | lokator / selektor | Sposób znalezienia elementu (XPath, CSS selector, ID). |

| Implicit / explicit wait | domyślne / jawne czekanie | Mechanizmy oczekiwania na załadowanie elementu (uniknięcie flaky tests). |

| Headless browser | przeglądarka bez UI | Selenium / Playwright bez wyświetlania okna (szybsze testy CI). |

| Test data management | zarządzanie danymi testowymi | Jak generować, czyścić, izolować dane testowe. |

| Mocking / stubbing | mockowanie / stubowanie | Symulacja zewnętrznych zależności w testach (Mockito, Sinon). |

| Flaky test | niestabilny test | Test, który czasem przechodzi, czasem nie — bez zmian w kodzie. Wróg automation. |

| CI/CD pipeline | potok CI/CD | Automatyczne uruchamianie testów po commicie (Jenkins, GitHub Actions, GitLab CI). |

Kategoria 5: Agile / Scrum (10)

Agile / Scrum

| EN | PL | Definicja |

|---|---|---|

| Sprint | sprint | 2-4 tygodniowy cykl pracy w Scrumie. |

| User story | historia użytkownika | „As a user, I want to... so that...". Wymóg w formie zdania. |

| Acceptance criteria | kryteria akceptacji | Lista warunków, które muszą być spełnione, żeby story była ukończona. |

| Definition of Done (DoD) | definicja ukończenia | Standardowy checklist dla każdej story (testy, code review, dokumentacja). |

| Backlog grooming / refinement | pielęgnacja backlogu | Spotkanie zespołu — przegląd i doprecyzowanie story. |

| Sprint planning | planowanie sprintu | Wybór story na nadchodzący sprint. |

| Daily standup | codzienne stand-up | 15-min spotkanie codziennie: co robiłem wczoraj, dziś, blockery. |

| Retrospective | retrospektywa | Po sprincie — co poszło dobrze, co źle, co poprawimy. |

| Story points | punkty story | Estymacja relatywna wysiłku (1, 2, 3, 5, 8, 13 — Fibonacci). |

| Velocity | prędkość zespołu | Średnia liczba story points dostarczanych na sprint. |

Kategoria 6: Performance & Security (10)

Testy wydajnościowe i bezpieczeństwa

| EN | PL | Definicja |

|---|---|---|

| Load testing | testy obciążeniowe | Sprawdzenie zachowania pod normalnym obciążeniem. |

| Stress testing | testy stresowe | Sprawdzenie zachowania pod ekstremalnym obciążeniem (znalezienie breaking point). |

| Spike testing | testy nagłych skoków | Nagłe zwiększenie ruchu (np. Black Friday). |

| Endurance / soak testing | testy długotrwałe | Długi czas (godziny / dni) pod stałym obciążeniem — szukanie memory leaks. |

| Throughput | przepustowość | Ile transakcji/sekundę aplikacja obsługuje. |

| Response time | czas odpowiedzi | Jak długo trwa odpowiedź serwera (zwykle < 200ms dla webów). |

| Penetration testing (pentest) | testy penetracyjne | Symulowane ataki w celu znalezienia luk bezpieczeństwa. Zobacz rodzaje cyberataków. |

| Vulnerability scanning | skanowanie podatności | Automatyczne narzędzie szuka znanych CVE w aplikacji. |

| SQL injection | wstrzyknięcie SQL | Atak przez wprowadzenie SQL w pole formularza. OWASP A03. |

| XSS (Cross-Site Scripting) | wstrzyknięcie skryptu | Wstrzyknięcie JavaScript wykonywanego u innych użytkowników. |

Kategoria 7: Career roles (10)

Role zawodowe w QA

| EN | PL | Co robi |

|---|---|---|

| QA Engineer / Tester | inżynier jakości / tester | Ogólna rola — manual + częściowo automation. |

| Manual Tester | tester manualny | Pisze i wykonuje testy ręcznie. Junior 6-9k PLN brutto. |

| Automation Tester | tester automatyzujący | Pisze test scripts (Selenium, Playwright). Junior 9-13k. |

| SDET (Software Development Engineer in Test) | programista-tester | Programista wyspecjalizowany w testowaniu. Senior 19-30k. |

| QA Lead / Test Lead | lider QA | Zarządza zespołem testerów, planuje strategię testową. |

| QA Manager | manager QA | Strategia QA, budżet, rekrutacja. 17-25k. |

| Performance Engineer | inżynier wydajności | Specjalizacja: load, stress, soak testing (JMeter, k6). |

| Security Tester / Penetration Tester | tester bezpieczeństwa | Specjalizacja: pentesty, OWASP. 15-25k. Pełen przewodnik tutaj. |

| Test Architect | architekt testowy | Senior — projektuje strategie i frameworki testowe. |

| QA Analyst | analityk QA | Analiza wymagań, projektowanie test cases, mniej hands-on. |

Kategoria 8: AI / ML testing (10)

AI / ML testing — nowa kategoria 2026

| EN | PL | Co to |

|---|---|---|

| Visual regression testing | testy wizualnej regresji | AI porównuje screenshots po każdej zmianie (Applitools, Percy). |

| Self-healing tests | samonaprawiające testy | AI automatycznie naprawia testy, gdy zmieni się UI (Mabl, Testim). |

| AI exploratory testing | eksploracja przez AI | AI samodzielnie wchodzi na aplikację i znajduje bugi (BugBot, Reflect). |

| Test data generation | generowanie danych testowych | AI tworzy realistyczne dane testowe (faker + LLM enhancements). |

| Test case generation | generowanie test case'ów | ChatGPT / Claude tworzy test cases na podstawie user story. |

| LLM testing | testowanie modeli LLM | Testy chatbotów, AI assistants — coverage, hallucination detection. |

| Prompt injection testing | testy wstrzyknięcia promptu | Specjalistyczna kategoria security testing dla AI applications. |

| Model fairness testing | testy uczciwości modelu | Czy model AI nie dyskryminuje grup (płeć, rasa, wiek). |

| Adversarial testing | testy adwersaryjne | Próby oszukania modelu specjalnie spreparowanymi danymi. |

| A/B testing | testy A/B | Klasyczny pattern: dwie wersje, statystyczny wybór lepszej (nie tylko AI, ale powiązane). |

ISTQB Foundation — co warto wiedzieć

ISTQB Foundation Level (CTFL — Certified Tester Foundation Level) to najpopularniejszy certyfikat QA w Polsce. Egzamin dostępny po polsku (jedyna duża korzyść tej certyfikacji — większość cyber/IT egzaminów jest tylko po angielsku).

Parametry egzaminu

- Cena: 200 EUR (≈850 PLN, 2026).

- Forma: 40 pytań wielokrotnego wyboru, 60 minut, próg zaliczenia 65% (26/40).

- Język: polski lub angielski (do wyboru).

- Ważność: bezterminowa (nie wygasa).

- Pojawia się w: 60% ofert junior jako „plus" lub „wymóg".

6 rozdziałów syllabusa

- Fundamentals of testing — podstawy (czemu testujemy, 7 zasad testowania).

- Testing throughout the SDLC — testowanie w cyklu wytwarzania (V-model, Agile).

- Static testing — testowanie statyczne (review, statyczna analiza).

- Test techniques — techniki projektowania testów (BVA, equivalence partitioning, decision tables).

- Test management — zarządzanie testami (planowanie, monitoring, ryzyka).

- Tool support for testing — narzędzia (typy, wybór, wdrożenie).

Plan przygotowania (3 miesiące, 1h dziennie)

- Miesiąc 1: oficjalny syllabus ISTQB CTFL v4.0 (≈100 stron) + kurs na Udemy/Coursera (np. Mike Hill „ISTQB Foundation").

- Miesiąc 2: książka „Foundations of Software Testing: ISTQB Certification" (Dorothy Graham) + practice tests (200+ pytań).

- Miesiąc 3: tylko practice tests, każdy wieczór 30-50 pytań. Cel: 80%+ stabilnie. Wtedy bookuj egzamin.

Po Foundation: Advanced Test Manager (CTAL-TM, dla liderów), Advanced Test Analyst (CTAL-TA, dla manualistów), Advanced Technical Test Analyst (CTAL-TTA, dla automation). Każdy 250-350 EUR + 200 godzin nauki. Realne ROI po 2-3 latach doświadczenia.

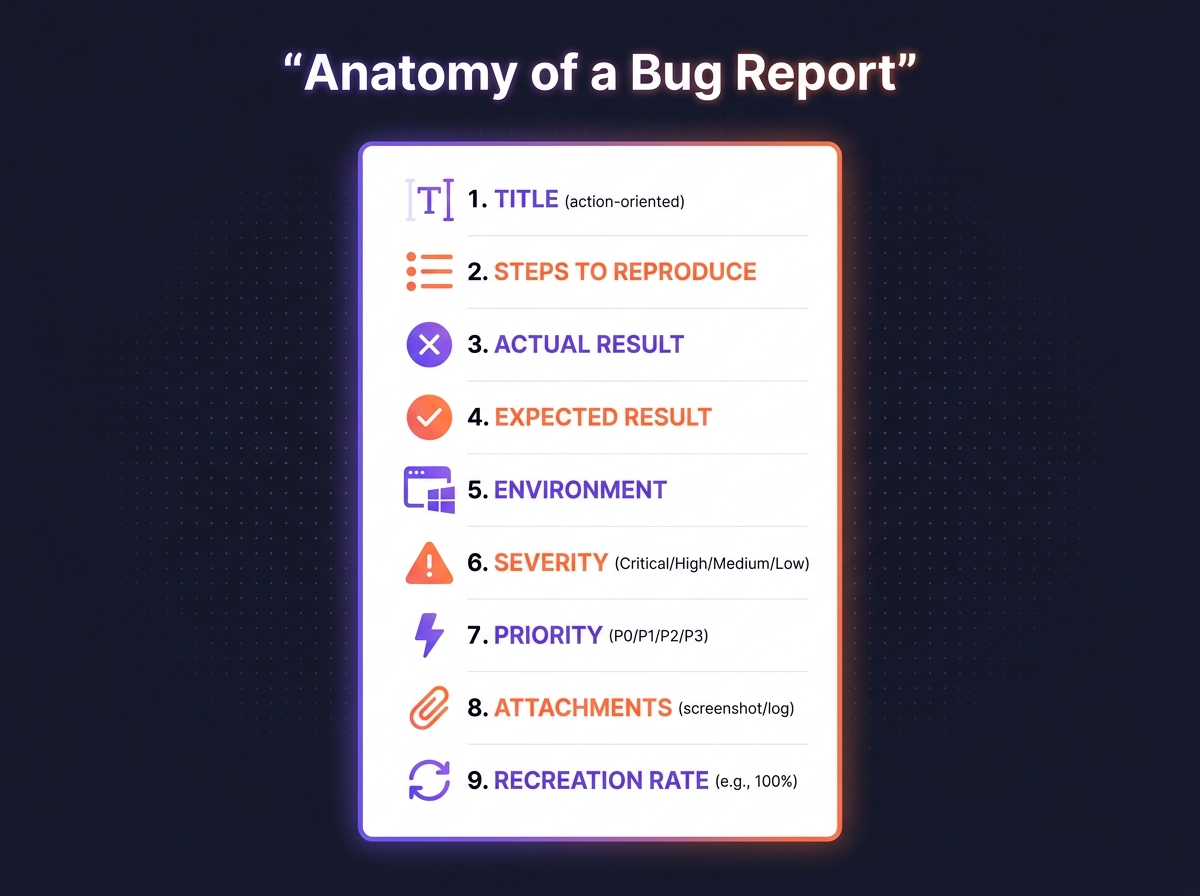

Jak napisać bug report po angielsku

Bug report to najczęściej tworzony artefakt testera. Pisany po angielsku w 95% polskich firm. Zła jakość = strata czasu programistów, pingpong w Jira, niezadowolony zespół. Anatomia profesjonalnego raportu:

9 sekcji bug raportu

- TITLE — krótki, opisowy, action-oriented.

❌ „Login broken".

✅ „Login fails with 500 error when password contains special characters". - STEPS TO REPRODUCE — numerowana lista. „Step 1: Navigate to login page. Step 2: Enter username 'test@example.com'. Step 3: Enter password 'P@ss!word#1'. Step 4: Click 'Login' button."

- ACTUAL RESULT — co się dzieje. „System returns 500 Internal Server Error after 30 seconds. Console shows 'TypeError: Cannot read property char of undefined'."

- EXPECTED RESULT — co POWINNO się stać. „Login should succeed and redirect to /dashboard within 2 seconds."

- ENVIRONMENT — Browser, OS, app version, account type. „Chrome 120.0, Windows 11 Pro, app v3.4.2, premium account."

- SEVERITY — wpływ na system: Critical (system unusable) / High (major feature broken) / Medium (minor feature broken) / Low (cosmetic).

- PRIORITY — pilność: P0 (fix now) / P1 (this sprint) / P2 (next sprint) / P3 (backlog).

- ATTACHMENTS — screenshot, screencast (Loom, OBS), browser console log, server log, HAR file.

- RECREATION RATE — „100% reproducible (5 of 5 attempts)" lub „Intermittent (3 of 5 attempts)" lub „Non-reproducible after 10 attempts".

Rule of thumb: piszesz bug raport tak, żeby programista mógł od razu zacząć debugować, bez zadawania ci żadnego pytania. Każde dodatkowe pytanie w komentarzach = strata 30 minut zespołu.

AI tools dla QA 2026

W 2026 znajomość AI tools to baseline dla testera. Pojawia się jako wymóg w 60% ofert mid+. Top 6 narzędzi:

Co robi: generuje test scripts (Selenium, Playwright, Cypress) na podstawie komentarzy. Auto-completes kod. Sugeruje edge cases.

Use case: „// test login with invalid credentials" → Copilot generuje całą metodę testową. 30-50% productivity boost dla automation.

Co robi: generuje test cases z user stories, edge cases, regression checklists, krytyka requirements, bug reports drafting.

Use case: wkleisz user story „As a user, I want to login with email/password" → AI generuje 30 test cases (happy path + edge cases + security). Pełny przewodnik w naszym artykule.

Co robi: AI visual regression — porównuje screenshots po każdej zmianie. Łapie subtelne różnice (padding zmieniony o 2px, kolor inny o 5%).

Use case: baseline screenshot → po deploymencie nowy screenshot → AI flag-uje różnice. Eliminuje 90% manual visual testing.

Co robi: AI-powered test automation. Self-healing testy — gdy zmieni się selector w UI, AI sam aktualizuje test. Eliminuje główny ból automation: ciągłą maintenance flaky tests.

Use case: developer zmienia ID przycisku z „submit-btn" na „login-submit". Tradycyjny Selenium test wybucha. Mabl/Testim automatycznie znajduje nowy element po wyglądzie i aktualizuje test.

Co robi: AI samodzielnie eksploruje aplikację — kliknie w setki kombinacji ścieżek, znajdzie nieoczekiwane bugi (crashes, błędy walidacji, broken UI).

Use case: uruchamiasz BugBot na nową feature. Po 30 minutach masz raport: „Found 12 issues — 3 critical, 5 high, 4 medium". Idealne uzupełnienie manual exploratory.

Co robi: piszesz test cases po angielsku w plain English („Click login button, enter email..."), AI tłumaczy na wykonywalne testy automation. Manual testers bez programowania mogą tworzyć automation.

Use case: demokratyzuje automation. Manual tester ze znajomością angielskiego B2+ tworzy automation bez Java/Python.

Ścieżka kariery — Manual → SDET

Realna ścieżka 0 → 5 lat w PL:

- Angielski B2+ (jeśli już masz, OK; jeśli nie, najpierw to).

- ISTQB Foundation (3 miesiące przygotowania, egzamin 850 PLN).

- 2-3 projekty hands-on: testowanie open source projektów, wpisy do bug tracker.

- Udemy course „QA fundamentals" + 50 godzin praktyki w Jira/TestRail.

- Pierwsza praca, manual testing, exploratory.

- Naucz się jednej domeny (web, mobile, API).

- Zacznij naukę programowania (Python lub JavaScript) wieczorami.

- Cel pod koniec roku: znasz Jira, TestRail, Postman, basic git.

- Pierwsze test scripts (Selenium / Playwright / Cypress).

- Page Object Model, locators, frameworks (TestNG, JUnit, pytest).

- CI/CD integration (GitHub Actions, Jenkins).

- Praktyka: 100+ napisanych test scripts.

- Specjalizacja: performance (JMeter, k6), security (OWASP), mobile (Appium), API (REST Assured).

- Mentoring junior testerów.

- Kontrybucja do test framework'a.

- Domain expertise (banking, healthcare, e-commerce).

- Strategia testowa dla całego projektu.

- Wybór tooli, frameworków, hire'owanie zespołu.

- Stakeholder management (komunikacja z biznesem).

- Opcjonalna ścieżka: Engineering Manager (techniczny + zarządczy).

Top 10 pytań na rozmowie kwalifikacyjnej QA

1. „Tell me about yourself."

Opowiedz coś o sobie.

60-sek elevator pitch: present (current role) → past (relevant experiences, e.g., 2 projects) → future (why this role at THIS company). Zobacz nasz przewodnik.

2. „What's the difference between QA and QC?"

Różnica między QA a QC?

QA (Quality Assurance) — proces zapobiegania defektom (process improvement). Proaktywne. QC (Quality Control) — testowanie produktu (znajdowanie defektów). Reaktywne. QA > QC w hierarchii — QA definiuje proces, QC go wykonuje.

3. „Smoke vs sanity vs regression testing?"

Smoke vs sanity vs regression — różnice?

Smoke: po nowym buildzie, sprawdzasz czy podstawowe funkcje działają (czy build jest „testable"). Krótko, szeroko. Sanity: po fixie konkretnego buga, sprawdzasz czy ten obszar działa. Wąsko, głęboko. Regression: po dowolnej zmianie, sprawdzasz czy nic INNEGO się nie zepsuło. Szeroko, średnio głęboko.

4. „STLC vs SDLC?"

STLC vs SDLC — różnica?

SDLC (Software Development Life Cycle) — pełny cykl wytwarzania (Requirements → Design → Develop → Test → Deploy → Maintain). STLC (Software Testing Life Cycle) — fragment SDLC dotyczący testów (Test Planning → Test Design → Test Execution → Test Closure). STLC jest „nested" w SDLC.

5. „Test case vs test scenario?"

Test case vs scenario?

Test case: step-by-step instrukcja („Step 1: open page. Step 2: click button..."). Specyficzne, niskopoziomowe. Test scenario: high-level user flow („User logs in and purchases an item"). Można rozłożyć na wiele test cases.

6. „Bug vs defect vs error?"

Bug vs defect vs error?

Error: human mistake (programmer wrote wrong code). Defect: the problem in the code (caused by error). Bug: defect found during testing. Failure: defect manifesting at user. Error → Defect → Bug (when found) → Failure (if reaches user).

7. „How do you prioritize bugs?"

Jak priorytetyzujesz bugi?

Macierz Severity × Priority. Severity = wpływ techniczny (Critical/High/Medium/Low). Priority = pilność biznesowa (P0/P1/P2/P3). Critical+P0 fix now (np. prod down). Low+P3 backlog. Plus: bugs blokujące inne testy idą do top, regardless of severity.

8. „Black box vs white box vs gray box?"

Czarna/biała/szara skrzynka?

Black box: bez znajomości kodu (tylko UI). Manual testing default. White box: z dostępem do kodu (unit testing, code coverage). Gray box: częściowy dostęp — np. znasz strukturę bazy danych, ale nie cały kod. Integration testing często gray box.

9. „Functional vs non-functional testing?"

Funkcjonalne vs niefunkcjonalne?

Functional: CO aplikacja robi (czy spełnia funkcjonalności z requirements). Login działa? Płatność przechodzi? Non-functional: JAK aplikacja działa. Performance (jak szybko), Security (jak bezpiecznie), Usability (jak wygodnie), Accessibility (czy dostępna dla niepełnosprawnych).

10. Scenariusz: „You found a bug in production. What next?"

Znalazłeś buga w produkcji — co robisz?

1. Verify it's reproducible (2-3 attempts). 2. Estimate severity + priority. 3. If Critical/P0: immediately notify Slack channel + create urgent Jira ticket + ping on-call developer. 4. Otherwise: create Jira ticket with full bug report. 5. Document workaround if exists. 6. Verify fix when developer claims it's resolved (regression test).

7 błędów polskich kandydatów

Błąd 1 — Tylko teoria ISTQB, brak praktyki

❌ Znasz definicje, ale nigdy nie pisałeś bug raportu w Jira ani test case w TestRail.

✅ 2-3 projekty hands-on: testowanie open source projektów, kontrybuowanie do bug tracker. W CV: link do GitHub portfolio z 5+ bug raportami.

Błąd 2 — Ignorowanie angielskiego

❌ „Jakoś sobie poradzę z angielskim, znam ze szkoły."

✅ B2+ w mowie i piśmie + 200-300 terminów branżowych. Bez tego nie przechodzisz CV-screen w 95% ofert. Test gotowości: napisz bug raport po angielsku, daj na review.

Błąd 3 — Brak znajomości AI tools

❌ Kandydat nie umie wymienić jednego AI tool dla QA.

✅ Znaj minimum 3: Copilot, ChatGPT (test cases), Applitools (visual). W 2026 brak AI tools = dyskwalifikator dla mid+.

Błąd 4 — Brak specjalizacji po 3 latach

❌ Po 3 latach manual testing wszystkiego — stagnacja kariery, plateau pensji.

✅ Wybierz domenę: web, mobile, API, performance, security. Plus 1 specjalizację techniczną (Selenium expert, JMeter expert). Domain expertise = +20-30% pensji.

Błąd 5 — Płytkie bug raporty w portfolio

❌ „Znalazłem bug w aplikacji X" — bez detali w portfolio.

✅ 5-10 case studies w GitHub: Title + Steps + Actual + Expected + Severity + jak rozwiązano. Pokazuje strukturalne myślenie.

Błąd 6 — Pomijanie programowania

❌ „Manual mi wystarczy, programowania się boję."

✅ Po 1-2 latach manual MUSISZ uczyć się programowania (Python lub JS). Bez tego sufit pensji 13k. Z automation skills 19-30k.

Błąd 7 — Brak networking / Linkedina

❌ Aplikujesz tylko przez No Fluff Jobs, brak aktywności na LinkedIn.

✅ LinkedIn po angielsku, network 500+ kontaktów, posty o nauce, udział w meetupach (Polish QA Meetup, KraQA). 30% ofert junior pochodzi z networkingu, nie z portali.

Linki do pogłębienia

- Rozmowa kwalifikacyjna IT po angielsku — 50 pytań

- CV po angielsku — wzór do pobrania

- LinkedIn po angielsku — profil

- ChatGPT i Claude do nauki angielskiego — 15 promptów

- Rodzaje cyberataków po angielsku — bonus dla security testerów

- Jak wejść do cybersecurity bez doświadczenia — alternatywna ścieżka

- Business English — 120 zwrotów (daily standupy, retro)

FAQ — najczęstsze pytania

Czy do pracy testera w PL trzeba angielskiego?

TAK — 90-95% ofert wymaga B2+. Polski rynek QA to globalne firmy. Cała dokumentacja, bug reporty, daily standupy po angielsku.

Manual czy automation na start?

Manual na start (niska bariera, szybka praca), automation jako specjalizacja po roku-dwóch. Pensje: manual junior 6-9k, automation junior 9-13k, SDET senior 19-30k.

Czy ISTQB jest wymagane?

NIE wymagane, ale przydatne (60% ofert junior jako „plus"). Egzamin 850 PLN, dostępny po polsku.

AI tools dla QA 2026?

Top 6: GitHub Copilot, ChatGPT/Claude (test cases), Applitools (visual regression), Mabl/Testim (self-healing), BugBot (exploratory), Functionize (low-code).

Jak napisać dobry bug report?

9 sekcji: Title (action-oriented) · Steps to reproduce (numbered) · Actual result · Expected result · Environment · Severity · Priority · Attachments · Recreation rate.

Top 10 pytań na rozmowie?

Tell me about yourself, QA vs QC, smoke/sanity/regression, STLC vs SDLC, test case vs scenario, bug/defect/error, jak priorytetyzujesz, black/white/gray box, functional vs non-functional, scenariusz „bug w produkcji".

Realne widełki w PL?

Manual junior 6-9k, mid 9-13k, senior 13-18k. Automation junior 9-13k, mid 13-19k, senior 19-28k. SDET 18-30k. Test Lead 17-25k. Big Tech +30-50%.

Największe błędy polskich kandydatów?

(1) Tylko teoria, brak praktyki. (2) Słaby angielski. (3) Brak AI tools. (4) Brak specjalizacji. (5) Płytkie bug raporty w portfolio.